LightTrack: Finding Lightweight Neural Networks for Object Trackingvia One-Shot Architecture Search

Abstract

Snapdragon845(Adreno GPU)を使用したOceanとの速度比較の結果は以下の通り。

- Oceanの12倍高速に動作

- パラーメータ数は13分の1に削減

- Flopsは38分の1に削減

既存のモデルに比べて圧倒的に高速に動作している。

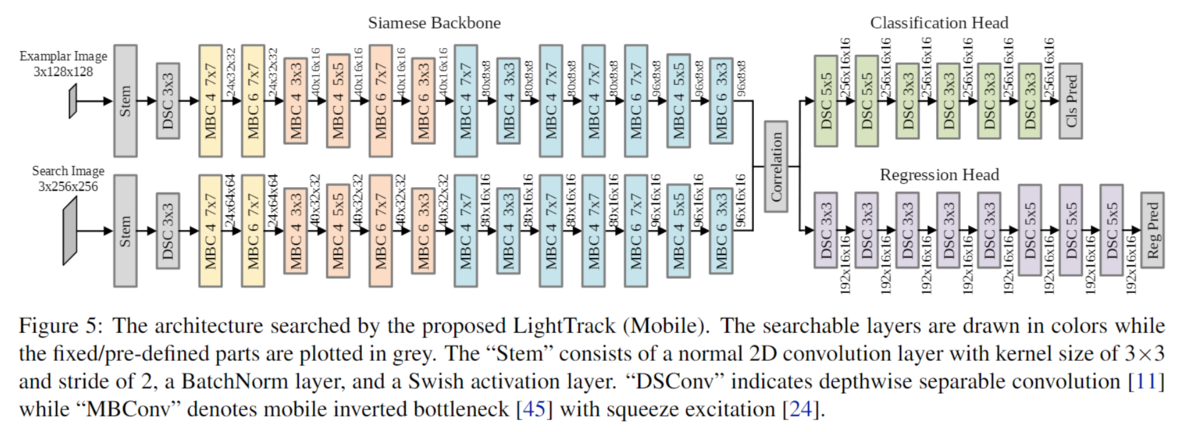

アーキテクチャ

学習時のパイプライン

学習は3ステップに分けて実行される。

1. Back BornのSupernetを学習

ImageNetで通常の画像分類タスクをcross-entropyで学習させる。

2. Tracking Supernetを学習

この段階では入力画像としてトラッキング対象の領域を切り取った画像と、その画像と対になる検索用の画像(トラッキングしたい物体が描画されている画像)を2つ受け取り、両方の特徴量を第1ステップで学習させたモデルを用いて獲得する。その後2つのCorrelationをとり、その値がHeadの部分の入力となり、HeadはClassificationとRegrression(トラッキング対象の矩形)の2つを出力する。Lossはこの2つの値で計算される。

3. 最後のステップでモデル構造の探索が実行される

モデルは3ステップで学習する。

LightTrack(mobile)

学習の結果得られたモバイルバージョンのLightTrack